キーワードから小説や画像を自動生成 自然言語処理の革命児「GPT-3」の衝撃(1/2 ページ)

機械学習分野の国際会議「NeurIPS 2020」(Neural Information Processing Systems)が、2020年12月6日から12日までオンラインで開催され、論文投稿数9000以上と盛り上がりを見せた。その中でBest Paper Awards(最優秀論文賞)に選ばれた論文の1つが「Language Models are Few-Shot Learners」だ。イーロン・マスク氏が創業した米企業OpenAIが2020年5月にプレプリントを公開した「GPT-3」が掲載された論文だ。

GPT-3は、入力した簡単な言葉から、人間が書いたかのような文章を生成する。高い精度の文章を生成する自然言語処理(Natural Language Processing、NLP)モデルとして注目を集めた。とはいえ、前バージョンモデルのGPT-2でその精度を実証していたため、一般的には目立っていなかった。しかし、APIの公開により広く知られることになった。

OpenAIはプレプリント公開年の6月、OpenAI APIのプライベートベータ版を発表した。ただし、GPT-3全体のソースコードや事前学習済みのモデルは公開せず、一部だけを使えるようにした。フェイクニュースなどに悪用される懸念からだ。一部の公開だけでも強力で、世界中の研究者やエンジニアなどはさまざまなアプリケーションを開発できるようになった。

例えば、どんなアプリが作りたいかをテキストで書けばソースコードが自動生成される。架空のタイトルとアーティストを書けばギターのタブ譜が生成され、欲しいWebページやボタンを書けばWebデザインが作られる。タイトルや作者名、最初の一言を書けば有名作家の小説を作ることもでき、話し言葉から数式の自動生成も可能だ。

これらは企業が豊富なリソースを使って開発したのではなく、世界中のユーザーがOpenAI APIを使って数日で作成したものだ。このことでGPT-3の汎用性の高さと認知が広まっていった。

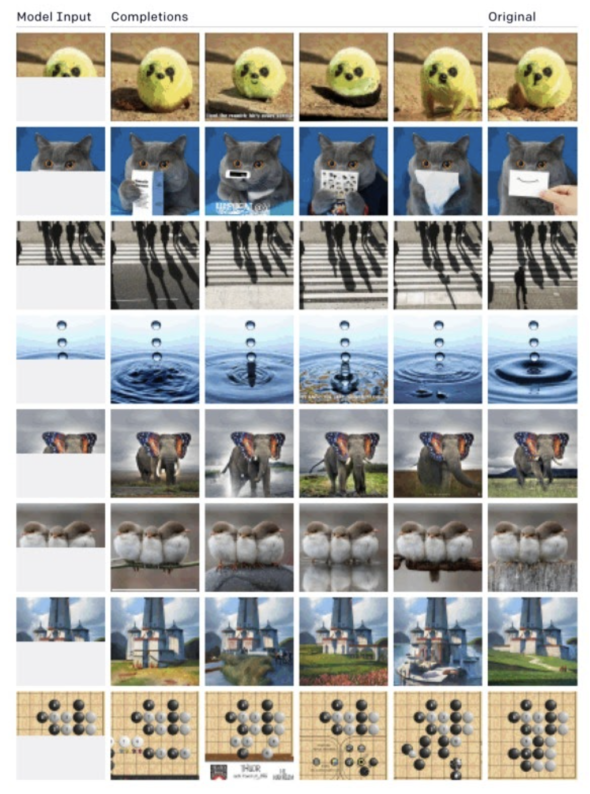

本家OpenAIでも言語以外への活用方法が模索されていた。OpenAIは2020年6月、前バージョンモデルGPT-2を画像に適応する「Image GPT」を発表した。Image GPTは、自然言語処理アーキテクチャを画像に利用し、半分の画像を入力すると、残りの画像を補完しもっともらしい画像を作り出す画像生成モデルだ。これがまた既存の画像生成モデルに引けを取らない出力結果を示し、GPTの汎用性の高さを知らしめた。

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR