画像を半分入れたら残りを自動生成 OpenAI、文章自動生成モデルの画像版「Image GPT」開発:Innovative Tech(1/3 ページ)

Innovative Tech:

このコーナーでは、テクノロジーの最新研究を紹介するWebメディア「Seamless」を主宰する山下裕毅氏が執筆。新規性の高い科学論文を山下氏がピックアップし、解説する。

OpenAIの研究チームが開発した「Image GPT」は、画像生成を学習するためのフレームワークだ。昨年、同チームが発表した自然言語の文章自動生成モデル「GPT-2」を画像に適用したもの。OpenAIはイーロン・マスク氏が共同会長を務める米国のAI研究企業(非営利)。

GPT-2は短い文章を入力すると、もっともらしい長文を自動的に作成してくれるモデルで、その精度の高さが一部で話題になった。モデルは800万のWebページのデータセットで訓練し、15億のパラメータを持つ48層のネットワークで構成。アルゴリズムは、RNN(Recurrent Neural Network)やCNN(Convolutional Neural Network)の再帰や畳み込みを用いず、Attentionのみ使ったTransformerを採用している。

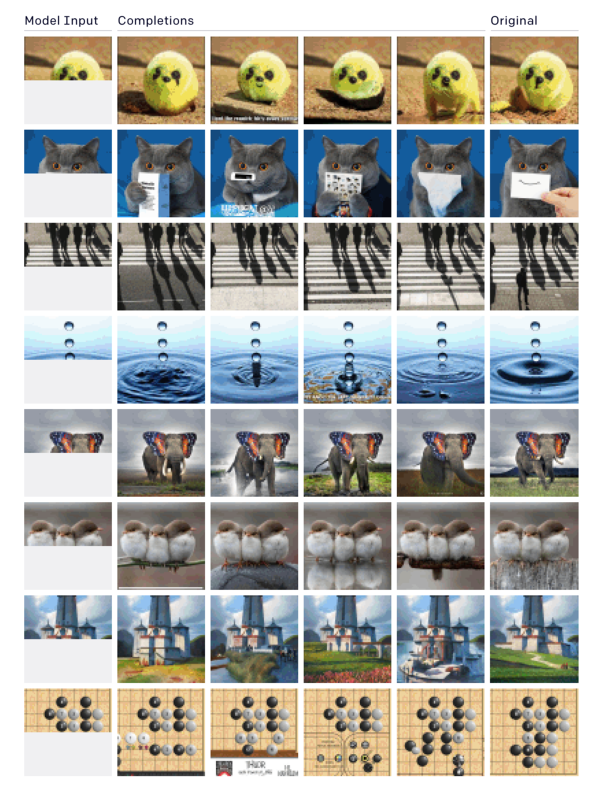

今回このモデルを画像で試したところ、画像補完によるもっともらしいサンプル画像を生成できることが分かった。画像の半分を入力に残りの画像を自動生成することで、認識可能なオブジェクトが写る一貫したサンプル画像を生成する。

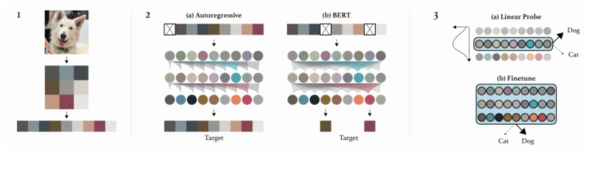

このネットワークでは、7600万のパラメーターを持つ「iGPT-S」、4億5500万のパラメーターを持つ「iGPT-M」、14億のパラメーターを持つ「iGPT-L」をそれぞれ含むTransformerを、大規模画像データセット「ImageNet」で訓練する。68億のパラメータを持つ「iGPT-XL」も、ImageNetとWebからの画像を組み合わせたデータセットで訓練する。入力画像から前処理として低解像度にリサイズし、1列のシーケンスに変換後、ピクセル系列をTransformerに入れ学習する。

学習したモデルを他の画像データセットで定量的にパフォーマンス評価した結果、ResNetやSimCLRなど教師あり/なしの画像学習モデルを上回り上々の結果を得られた。しかし、低解像度に限られるなど課題も残している。

Copyright © ITmedia, Inc. All Rights Reserved.

続きを読むには、コメントの利用規約に同意し「アイティメディアID」および「ITmedia NEWS アンカーデスクマガジン」の登録が必要です

Special

PR